- IA Express

- Posts

- Benchmarking avalia modelos de IA em investigações de cibersegurança

Benchmarking avalia modelos de IA em investigações de cibersegurança

Bem-vindos, humanos: Seu download com as principais notícias sobre Inteligência Artificial começa agora. Nesta edição, você verá como a IA está atuando em investigações complexas de cibersegurança, mas também colaborando com ataques que usam vozes clonadas em tempo real.

Porém isso não é tudo na IA Express de hoje:

- Origin é uma família de nove modelos que preveem a longevidade humana

- OpenAI é obrigada a revelar identidade por trás de prompts do ChatGPT

- Ferramenta de IA promete extrair o que realmente importa de vídeos longos

- WhatsApp banirá chatbots de propósito geral, como ChatGPT e Perplexity

Porque, no mundo da Inteligência Artificial, conhecimento é seu algoritmo mais valioso.

AI_NEWS_CIRCUIT

SEGURANÇA

Benchmarking avalia modelos de IA em investigações de cibersegurança

A aplicação da Inteligência Artificial na segurança cibernética está indo além da simples identificação de padrões. Hoje, a IA pode atuar como um analista completo, capaz de raciocinar, investigar e explicar suas descobertas em ataques cibernéticos complexos.

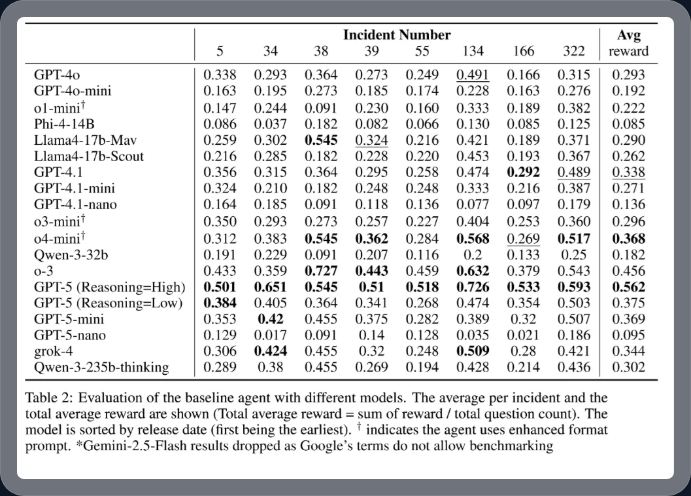

No entanto, sistemas tradicionais de benchmarking que avaliam os modelos de IA nessas tarefas geralmente ficam aquém, analisando apenas o cenário trivial. Para fechar essa lacuna, a Microsoft desenvolveu o ExCyTin-Bench (Execution-Constrained, Yield-Transparent, Investigation-based Benchmarking).

Como funciona? O ExCyTin-Bench avalia a capacidade dos modelos de IA de espelhar o fluxo de trabalho complexo de um analista de segurança, desafiando-os a usar ferramentas e consolidar evidências sob restrições parecidas com as do mundo real.

O ExCyTin-Bench fornece recompensas para cada ação que o modelo de IA toma durante uma investigação. Isso significa ver mais que uma simples conclusão, mas também como o modelo chegou lá – e quais passos foram bons e quais não foram.

Crédito: Microsoft

E quais foram os resultados? Os modelos mais recentes, entre eles GPT-5 (High Reasoning), tiveram melhor desempenho. Quando os recursos de raciocínio foram desativados, o desempenho caiu quase 19% considerando os mesmos modelos. Isso destaca que o raciocínio aprofundado passo a passo (Chain-of-Thought ou CoT) é um fator indispensável para investigações de segurança complexas.

Modelos menores com raciocínio CoT já estão se equiparando ao maiores e mais antigos, oferecendo bom desempenho a um custo mais baixo.

E modelos de código aberto estão avançando rapidamente na direção de desempenho de soluções proprietárias, o que torna a cibersegurança automatizada de alta qualidade mais acessível a todas as organizações.

AI_TRENDS

Ring-1T, desenvolvido pelo Ant Group, é reconhecido como o melhor LLM de código aberto com capacidade de raciocínio.

Qwen Deep Research agora cria não apenas relatórios, mas também páginas Web e podcasts.

FlashWorld produz cenas 3D de alta qualidade a partir de um único prompt de texto ou imagem.

Krea Realtime 14B gera vídeos de longa duração em tempo real com movimentos complexos.

Fish Audio S1 é um modelo do tipo TTS capaz de clonar vozes a partir de 10 segundos de áudio, capturando características como sotaque, tom e ritmo de fala.

Origin é uma família de nove modelos de otimização genética que preveem a longevidade humana do DNA de um embrião com precisão.

Anthropic fez várias melhorias no modelo Claude para torná-lo um melhor parceiro para aqueles que trabalham com ciências da vida.

Claude Code ganhou uma versão Web para que tarefas de programação possam ser dadas diretamente do navegador (para planos Pro e Max).

YouTube lançou uma ferramenta de IA para criadores de conteúdo elegíveis que detecta o uso de semelhanças (rosto e voz) em vídeos sem consentimento. ▶️🔴

AI_VENTURES

DEEPFAKE VISHING

Vozes agora podem ser clonadas em tempo real

O cenário da cibersegurança atingiu uma nova fronteira perigosa com o surgimento da técnica deepfake vishing (phishing de voz) que usa modelos de IA para clonar e reproduzir a voz de uma pessoa em tempo real, com latência mínima e usando apenas hardware de consumo, conforme demonstrou o NCC Group.

|  |

Pesquisadores do NCC Group demonstraram como a nova armadilha funciona. Usando modelos de IA sofisticados, muitas vezes treinados com apenas cinco minutos de áudio disponível publicamente, os criminosos podem fazer a conversão de voz em tempo real.

Embora uma GPU de ponta posso oferecer melhor desempenho, a demonstração do NCC Group usou apenas um laptop com uma das GPUs mais simples da NVIDIA para que o atraso de voz fosse de apenas meio segundo.

A voz clonada pode ser transmitida por ligações telefônicas ou aplicativos de reunião como Teams ou Zoom, fazendo com que a conversa pareça totalmente autêntica.

AI_GOVERNANCE & ETHICS

🕵️♂️ Identidade revelada

Em um caso envolvendo Inteligência Artificial e privacidade digital, a OpenAI se viu obrigada a revelar a identidade por trás de prompts do ChatGPT aparentemente inofensivos como parte de uma investigação federal sobre conteúdo de abuso sexual infantil distribuído na dark web. Sem precedente, esse mandado de busca feito pelo Tribunal Distrital de Maine (EUA) está relacionado a um veterano militar suspeito de administrar um fórum com material de abuso sexual infantil, reunindo mais de 300 mil usuários. A OpenAI teve de fornecer informações de identificação do usuário, detalhes das conversas com ChatGPT, endereço e dados de pagamento.

🍟 Junk food digital

Estudo revela que a exposição prolongada a conteúdo on-line de baixa qualidade, apelidado de junk food digital, pode causar um declínio cognitivo irreversível dos grandes modelos de linguagem (LLMs). Usando dados reais do X, pesquisadores realizaram experimentos controlados usando duas métricas: grau de engajamento e qualidade semântica. Quatro LLMs foram pré-treinados a partir de conjuntos de dados com variação de 0% a 100% de lixo, depois avaliados em termos de raciocínio, memória, segurança e traços de personalidade. O resultado? Quando treinados com lixo eletrônico, os modelos apresentaram queda significativa de raciocínio e pior compreensão de contextos longos. Também foram menos propensos a seguir normas éticas e exibiram personalidades socialmente indesejáveis.

AI_SNAPSHOT

💡 Inovação & Inspiração

Mais recursos a caminho Google está incrementando seu agente de engenharia de software Jules com dois novos recursos, Quick Sketch e Interactive Plan, para orientar os desenvolvedores das fases críticas de planejamento ao design de interfaces. Em vez de pular direto para a geração do código, o Jules agora usa o Interactive Plan para interagir com o desenvolvedor por meio de perguntas detalhadas e esclarecer requisitos, absorver documentação externa e definir o escopo. Já o Quick Sketch gera designs de interface do usuário diretamente no Jules. O cronograma de lançamento dos recursos ainda não foi especificado. 📋📱👨🏻💻

Inteligência latente Pesquisadores da Universidade de Harvard defendem que há como desenvolver capacidades avançadas de raciocínio em grandes modelos de linguagem (LLMs) - aqueles sem pós-treinamento especializado - puramente por meio de técnicas inteligentes durante a inferência (quando fazem previsões ou tira conclusões a partir de dados ainda não vistos). A ideia desafia o domínio do aprendizado por reforço (RL) para incrementar o raciocínio em LLMs, argumentando que modelos de base já abrigam inteligência latente que pode ser reavivada sem treinamento nem dados extras. 🧠💡✨

🌍 IA Global

🗺️ Superinteligência em questão Figuras públicas nos campos da tecnologia e da política assinaram uma carta aberta no Future of Life Institute (FLI) defendendo a proibição global do desenvolvimento da superinteligência até que duas condições principais sejam atendidas: amplo consenso científico de que a superinteligência pode ser desenvolvida de forma segura e controlável; e forte adesão ou aprovação pública. A carta enfatiza que não se trata de pausa temporária, mas de uma proibição condicional até que esses requisitos de segurança e legitimidade sejam atendidos.

🇬🇧 Nas profundezas do oceano Pesquisadores do British Antarctic Survey (BAS) estão utilizando IA para transformar a forma como estudam a vida no fundo do Oceano Antártico. Os cientistas rotularam cada animal em 100 imagens do fundo do mar. Aprendendo com essas imagens, a IA agora detecta e identifica seres em imagens subaquáticas em segundos, reduzindo o tempo de análise de até oito horas por foto para resultados quase instantâneos. Esse salto de eficiência está permitindo uma exploração mais rápida e em larga escala de um dos ecossistemas mais remotos e vulneráveis da Terra.

🔢 IA em números

|

|

AI_TOOLKIT

🛠️Ferramentas

TLDW, ou Too Long; Didn't Watch, promete extrair o que realmente importa de vídeos longos.

Google AI Studio ganhou um tom de “vibe coding” para criar aplicativos em minutos usando prompts em linguagem natural e módulos de recursos de IA.

Perplexity TV App, exclusivo para TVs Samsung 2025, permite fazer perguntas e pesquisas e descobrir novos conteúdos usando voz ou teclado; vem assinatura gratuita de 12 meses do Perplexity Pro.

📚 Miscelânea

Google Skills consolida conteúdo de treinamento técnico para Google Cloud, Google DeepMind, Grow with Google e Google for Education. Reúne quase 3.000 cursos gratuitos, aulas práticas e credenciais para atender à crescente demanda por experiência em IA.

AI_FLASH_NEWS

A partir de 15 de janeiro de 2026, WhatsApp banirá chatbots de IA de propósito geral, como ChatGPT e Perplexity, de sua Business API. Bots de negócios, como os de atendimento ao cliente, não serão afetados.

Meta está cortando cerca de 600 postos em unidades de IA legadas, inclusive FAIR; TBD Lab recém-criado permanece intocado.

Reddit processou Perplexity e outras três empresas de data-scraping por burlarem proteções técnicas e roubarem conteúdo para treinamento de IA.

Em carta a investidores, Netflix afirma estar "muito bem posicionada para explorar efetivamente os avanços em IA”.

OpenAI adquiriu Software Applications Incorporated (SAI), startup por trás da Sky, interface de IA em linguagem natural para macOS.

David Solomon, CEO da Goldman Sachs, diz que a principal diferença entre IA e revoluções passadas no mercado de trabalho é o ritmo da mudança.

Holandesa Axelera AI lançou Europa, processador para inferência de alto desempenho em aplicações de IA Generativa e visão computacional.

GM vai integrar IA com Gemini nos veículos a partir do ano que vem para que motoristas falem com seus carros de forma natural. Futuramente, terá uma IA própria desenvolvida sob medida para seus produtos. ✇🚘🗣

Até a próxima

Obrigado por mergulhar nesta edição. Seu tempo é valioso, e estamos felizes por você ter escolhido passar alguns minutos aqui.

Voltaremos à sua caixa de entrada em breve. Até lá, cultive a curiosidade.😊