- IA Express

- Posts

- Como a IA está redefinindo as áreas de dados e análises nas empresas

Como a IA está redefinindo as áreas de dados e análises nas empresas

Bem-vindos, humanos: Seu download com as principais notícias sobre Inteligência Artificial começa agora. Nesta edição, você saberá como a IA está se tornando a força motora por trás de decisões de negócios, remodelando dados e análises. Também conhecerá um novo agente de IA que está dominado a arte da otimização de algoritmos, competindo com grandes mentes humanas. 📊📈⚙️✅

Porém isso não é tudo no IA Express de hoje:

- Modelo para OCR gera documentos prontos para serem processados por LLMs

- Personas desalinhadas em LLMs podem levar a comportamentos tóxicos

- Novo modelo do Google DeepMind cria músicas em tempo real

- Estudo de Stanford analisa como agentes de IA transformam o local de trabalho

Porque, no mundo da Inteligência Artificial, conhecimento é seu algoritmo mais valioso.

AI_NEWS_CIRCUIT

NEGÓCIOS

Como a IA está redefinindo as áreas de dados e análises nas empresas

Um cenário em rápida evolução, no qual a Inteligência Artificial não é apenas uma ferramenta, mas uma força transformadora, foi o que desenharam as previsões mais recentes do Gartner nas áreas de dados e análises.

O que vem pela frente:

50% das decisões de negócios serão incrementadas ou totalmente automatizadas por agentes de IA voltados à inteligência de decisão até 2027. Esses agentes vão simplificar julgamentos complexos, analisando dados de diversas fontes e permitindo escolhas mais rápidas e mais bem embasadas.

Até 2027, organizações que priorizarem a “alfabetização” em IA para executivos deverão alcançar resultados financeiros 20% melhores em comparação com aquelas que não o fizerem. Os executivos deverão entender oportunidades, riscos e custos da IA para fazer investimentos fundamentados.

O Gartner adverte que 60% dos líderes de Data&Analytics enfrentarão falhas críticas na gestão de dados sintéticos até 2027, colocando em risco a governança, a conformidade e a precisão dos modelos de IA.

Até 2028, 30% dos pilotos de IA Generativa em produção serão desenvolvidos internamente em vez de implantados de forma empacotada.

Organizações que priorizarem a semântica nos dados para serem usados pela IA poderão ter até 80% mais precisão nos modelos de IA Generativa e custos 60% menores até 2027. Semântica ruim geralmente leva a alucinações, maior uso de tokens e custos computacionais mais elevados.

“A IA não agrega valor isoladamente. Deve se alinhar com dados, análises e governança para permitir decisões inteligentes e adaptáveis em toda a organização.”

Conclusão em uma frase, podemos dizer que as previsões do Gartner ressaltam que o sucesso da IA nas empresas dependerá de sua integração com estruturas robustas de dados, análises e governança.

AI_TRENDS

Novo recurso permite criar vídeos curtos usando IA enviando prompts de texto diretamente para a conta AskPerplexity no X.

OpenAI liberou, apenas para planos Pro, Enterprise e Edu no desktop do macOS, o Record Mode que transcreve e resume reuniões e notas de voz.

Deezer anunciou o primeiro sistema de marcação para streaming de música que rotula álbuns com faixas totalmente geradas por IA.

Novo agente de pesquisa Kimi-Researcher da Moonshot AI alcançou pontuação de 26,9% no Last Exam da Humanity, superando o desempenho dos agentes de pesquisa aprofundada do Google e da OpenAI.

Nanonets-OCR-s é um modelo para reconhecimento óptico de caracteres que gera documentos estruturados, prontos para serem processados por LLMs.

Canva integrou o modelo Veo 3 do Google para facilitar a geração de vídeos.

OpenAI fez no GitHub uma demonstração de um agente de IA para testes automatizados de front-end.

DeepResearch Bench avaliou agentes de IA em 100 tarefas de pesquisa de nível de doutorado em 22 campos distintos. Quem lidera? Gemini 2.5 Pro.👨🎓

AI_VENTURES

BENCHMARKING & AGENTES DE IA

Novo agente de IA se especializa em otimização de algoritmos

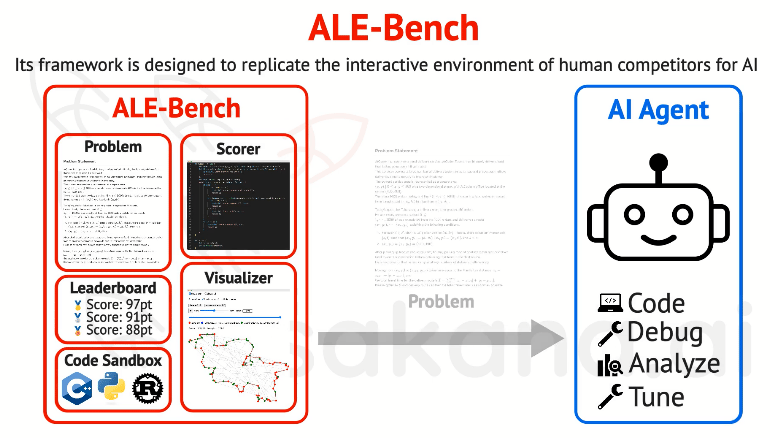

Uma recente colaboração entre Sakana AI e a plataforma de programação competitiva AtCoder culminou no desenvolvimento do ALE-Bench (ALgorithm Engineering Benchmark), sistema de benchmarking para área de engenharia de software criado especificamente para testar agentes de IA em problemas desafiadores de otimização de algoritmos.

O que você precisa saber:

Os pesquisadores perceberam que as ferramentas de benchmarking disponíveis não avaliavam bem a capacidade da IA de resolver problemas que exigem raciocínio de longo prazo e refinamento iterativo.

Para preencher essa lacuna, criaram o ALE-Bench utilizando problemas inspirados nos AtCoder Heuristic Contests (AHC) que não têm uma solução "exata" conhecida, mas apresenta um caminho que pode ser aprimorado ao longo de iterações.

ALE-Bench avalia a capacidade de refinamento de soluções iterativas em horizontes de longo prazo, que são fundamentais na otimização de problemas difíceis.

|  Crédito: Sakana AI |

E mal veio ao mundo, o ALE-Agent já demonstrou sua destreza algorítmica, alcançando um louvável 21º lugar no AHC em uma competição ao vivo contra mais de 1.000 participantes humanos. Ainda assim, a equipe da Sakana AI reconhece algumas limitações do novo agente que servirão de sinais claros para direcionar futuras pesquisas.

AI_GOVERNANCE & ETHICS

🎭 Personas desalinhadas

Pesquisadores da OpenAI identificaram “personas desalinhadas” dentro dos grandes modelos de linguagem, como o GPT-4o, que podem levar a comportamentos tóxicos. Essas personas, que são padrões neurais internos, emergem dos dados de treinamento e podem ser ativadas sob certas condições. O desalinhamento pode fazer com que os modelos produzam informações incorretas ou prejudiciais, sugiram atividades ilegais ou expressem sentimentos anti-humanos. A boa notícia? Os pesquisadores também descobriram que é possível controlar esses comportamentos desalinhados manipulando características internas ligadas às personas tóxicas. Outra boa notícia? Nem todas as personas são mal-intencionadas; existem as prestativas e honestas.

🛡️Proteção para agentes de IA

Agentes de IA alimentados por grandes modelos de linguagem (LLMs) estão cada vez mais versáteis, capazes de abordar um amplo espectro de tarefas, mas garantir sua segurança tem disso um desafio crítico, principalmente quando esses modelos lidam com informações confidenciais. Um grupo de pesquisadores propôs um conjunto de padrões para criar modelos de IA resistentes à injeção de prompts - tipo de ataque cibernético que tem como alvo LLMs e sistemas de IA e usam entradas de texto (prompts) mal-intencionadas em substituição às instruções originais. São seis padrões que impõem um grau de isolamento entre dados não confiáveis e o fluxo de controle dos modelos. Com isso, restringem as ações dos modelos para impedi-los de resolver tarefas arbitrárias, oferecendo um equilíbrio entre produtividade e segurança. Saiba mais aqui.

AI_SNAPSHOT

💡 Inovação & Inspiração

Produção de músicas em tempo real Treinado com quase 190.000 horas de música instrumental, o novo modelo Magenta RealTime, do Google DeepMind, permite criar e controlar músicas em tempo real usando prompts de texto, amostras de áudio ou uma combinação de ambos.

Pode ser usado em um hardware comum, o que o torna acessível para músicos, artistas e entusiastas que queiram fazer performances ao vivo, criar ambientes interativos ou produzir trilhas sonoras dinâmicas para videogames. 🎵🎧🎛️Óculos atléticos Conforme adiantado na semana passada, Meta e Oakley uniram forças para lançar o Oakley Meta HSTN, primeiro modelo da nova categoria de óculos Performance AI. A colaboração combina o icônico design esportivo da Oakley com os recursos de IA da Meta para redefinir como atletas se envolvem com tecnologia. Para quem gosta de ação, os óculos vêm com uma câmera 3K Ultra HD voltada para de vídeo em primeira pessoa e captura de fotos. Além disso, basta dizer “Hey, Meta” para que um assistente pessoal ajude com informações em tempo real ou comece fazer gravações. E com poderosos alto-falantes integrados, dá para fazer exercícios ouvindo a playlist favorita ou podcasts. São resistentes à água nível IPX4 e possuem bateria com autonomia de oito horas.😎🏀⚽

🌍 IA Global

🇬🇧 Não treina modelos A BBC ameaçou abrir uma ação judicial contra a Perplexity por scraping de conteúdo. Esse é o primeiro movimento legal da emissora inglesa contra uma empresa de IA por uso de material protegido por direitos autorais. Além de utilizar o material para treinamento de modelos, a BBC afirma que a Perplexity reproduziu conteúdo, às vezes imprecisamente, em seus resultados de pesquisa. Exige que a Perplexity interrompa com o processo de scraping, exclua o material copiado e ofereça compensação financeira. A Perplexity, por sua vez, nega as acusações, chamando-as de "oportunistas" e explica que não faz treinamentos, apenas oferece uma interface de utilização dos modelos.

🇪🇺 Rotas mais sustentáveis O Google Maps está usando IA para recomendar opções de rotas sustentáveis na Europa, analisando inteligentemente tempos de viagem, sugestões de transporte público ou caminhada. Além de lidar com viagens individuais, o Google Maps está conduzindo o Projeto Green Light para abordar a gestão do tráfego urbano. Também com a ajuda da dupla IA-Maps, identifica tendências e recomenda planos otimizados para os semáforos.

🔢 IA em números

|

|

AI_TOOLKIT

🛠️Ferramentas

Voice Design é um gerador de vozes da MiniMax que trabalha com vários idiomas, sotaques e estilos.

PartPacker é uma ferramenta desenvolvida pelo NVIDIA Research que cria modelos 3D detalhados a partir de uma única foto do objeto.

📚 Miscelânea

Novo estudo da Anthropic sobre desalinhamento dos modelos de IA revelou que muitos deles recorrem a comportamentos antiéticos, como sabotagem ou chantagem, quando seus objetivos ou funcionamento são ameaçados. Veja quem são os mais sabotadores ou chantagistas aqui.

O estudo Future of Work da Stanford SALT Lab se concentrou em analisar como agentes de IA estão transformando o local de trabalho, especialmente nos Estados Unidos. Envolveu 1.500 profissionais em 104 ocupações para entender as preferências de automação e como elas se alinham com as atuais capacidades da IA. O principal resultado? Há um descompasso entre o atual foco dos estudos em IA e as reais demandas dos trabalhadores.

AI_FLASH_NEWS

Meta planeja contratar Daniel Gross, CEO da Safe Superintelligence, após uma tentativa frustrada de adquirir sua startup de IA.

Mira Murati, ex-diretor de tecnologia da OpenAI, levantou US$ 2 bilhões em uma rodada de financiamento para sua startup Thinking Machines Lab.

NVentures, braço de capital de risco da NVIDIA, investiu na TerraPower, startup de energia nuclear fundada por Bill Gates. Com esse investimento, a TerraPower fechou uma rodada de captação de recursos de US$ 650 milhões.

NVIDIA e Foxconn estão discutindo a implantação de robôs humanoides na nova instalação em Houston para fabricar servidores de IA.

Wix adquiriu a plataforma Base44 de vibe coding por US$ 80 milhões.

Quatro executivos seniores da Palantir, Meta e OpenAI foram nomeados tenentes-coronéis do Exército dos Estados Unidos em uma unidade criada para reunir especialistas em Big Tech.

Apple está enfrentando uma ação coletiva de fraude em valores mobiliários movida por acionistas, alegando que a empresa enganou os investidores sobre o cronograma e recursos avançados de IA da Siri.

Mais uma da Apple: Empresa tem discutido a possibilidade de adquirir a Perplexity. Outra que chegou a avaliar uma possível aquisição foi a Meta, que optou por fazer um investimento bilionário na Scale AI. 🍎🛒

Até a próxima

Obrigado por mergulhar nesta edição. Seu tempo é valioso, e estamos felizes por você ter escolhido passar alguns minutos aqui.

Voltaremos à sua caixa de entrada em breve. Até lá, cultive a curiosidade.😊