- IA Express

- Posts

- LLMs ganham liberdade de expressão

LLMs ganham liberdade de expressão

Bem-vindos, humanos: Seu download diário com as principais notícias sobre Inteligência Artificial começa agora. Nesta edição, você conhecerá um método que libera LLMs como o DeepSeek para responder perguntas delicadas sem censura. E sabia que a OpenAI está sonhando em comprar o Chrome para redefinir a experiência inicial dos usuários com Inteligência Artificial? 💭💭💭

Porém isso não é tudo no IA Express de hoje:

- Microsoft desenvolve modelo de IA para usar em PCs

- Desafio internacional entre startups busca eficiência energética para IA

- OpenAI apresenta discretamente Memory with Search - veja como controlar

Porque, no mundo da Inteligência Artificial, conhecimento é seu algoritmo mais valioso.

AI_NEWS_CIRCUIT

SEM VIESES E CENSURA

LLMs ganham liberdade de expressão

Um novo método desenvolvido pela startup de gestão de riscos corporativos CTGT permite que grandes modelos de linguagem (LLMs) como o DeepSeek respondam a perguntas sensíveis, contornando vieses e censura. O método supostamente elimina 100% da censura e some de vez com as mensagens do tipo "Desculpe, não posso responder isso".

Como funciona? A estrutura da CTGT se concentra em localizar e modificar os elementos internos responsáveis pela censura dentro dos modelos de linguagem.

A inovação do CTGT garantiu uma chave-mestra aos modelos. Em linhas gerais, o método identifica partes específicas do modelo que controlam a relutância em responder determinadas perguntas.

Em seguida, ajusta esses elementos. O resultado? Uma IA mais aberta a abordar tópicos complexos sem perder a inteligência para outras tarefas.

Em testes, o DeepSeek modificado passou dar respostas a perguntas sensíveis em 96% dos casos versus 32% no modelo não modificado.

Crédito: CTGT

Embora tenha sido desenvolvido com o DeepSeek-R1-Distill-Llama-70B em mente, o mesmo processo pode ser usado com outros modelos, diz a CTGT.

MONOPÓLIO

Google como experiência inicial dos usuários com IA

A OpenAI consideraria comprar o navegador Chrome do Google se órgãos reguladores dos Estados Unidos forçassem sua venda para restaurar a concorrência no setor de buscas on-line.

Veja uma breve respectiva do caso:

Tudo começou em outubro de 2020, quando o Departamento de Justiça dos Estados Unidos (DOJ) apresentou uma queixa antitruste contra o Google, acusando-o de manter ilegalmente um monopólio nos mercados de serviços de busca e publicidade relacionada.

Em agosto de 2024, um juiz federal decidiu que o Google detém, de fato, esse monopólio. O DOJ reafirmou em março de 2025 a exigência para que o Google vendesse o Chrome e, potencialmente, o Android.

O julgamento antitruste começou em 21 de abril passado. O Departamento de Justiça expressou preocupações de que o Google possa explorar a IA para fortalecer seu domínio nas buscas.

Imagem fictícia

E agora, em mais um dia de julgamento, Nick Turleyo, chefe da OpenAI para produtos ChatGPT, afirmou que a aquisição do Chrome permitiria à empresa "oferecer uma experiência realmente incrível" e apresentar aos usuários a "experiência inicial com IA".

AI_TRENDS

O Grok ganhou um recurso que permite fazer perguntas sobre objetos vistos pela câmera do smartphone, algo semelhante ao que há no Gemini e no ChatGPT. Também pode trabalhar com áudio multilíngue e pesquisa em tempo real no modo de voz.

A mais recente tendência viral do ChatGPT é identificar locais a partir das fotos enviadas usando os recursos aprimorados de análise de imagens da IA.

Durante uma palestra no TED, o Google apresentou a nova plataforma Android XR que vai levar o poder da IA a óculos e headsets.

A nova opção de API da OpenAI chamada Flex Processing tem custo mais baixo em troca de respostas mais lentas e disponibilidade de menos recursos.

A ByteDance afirma que seu novo modelo Seedream 3.0 para geração de imagens supera o GPT-4o em velocidade, precisão e qualidade visual.

O chatbot Grok ganhou um recurso para se lembrar de conversas anteriores e dar respostas mais personalizadas, igualando-se ao ChatGPT e Gemini.

A Meta FAIR apresentou avanços em cinco projetos nas áreas de inteligência de máquina avançada (AMI) com foco em percepção, localização e raciocínio.

O Aura-2, modelo de conversão de texto em voz (TTS) da Deepgram para uso profissional, quer concorrer com ElevenLabs, Cartesia e OpenAI.

O modelo Wan 2.1-FLF2V-14B da Alibaba permite carregar imagens do primeiro e do último quadro para gerar vídeos de alta qualidade

AI_VENTURES

MODELO QUANTIZADO

Microsoft desenvolve modelo de IA eficiente para usar em PCs

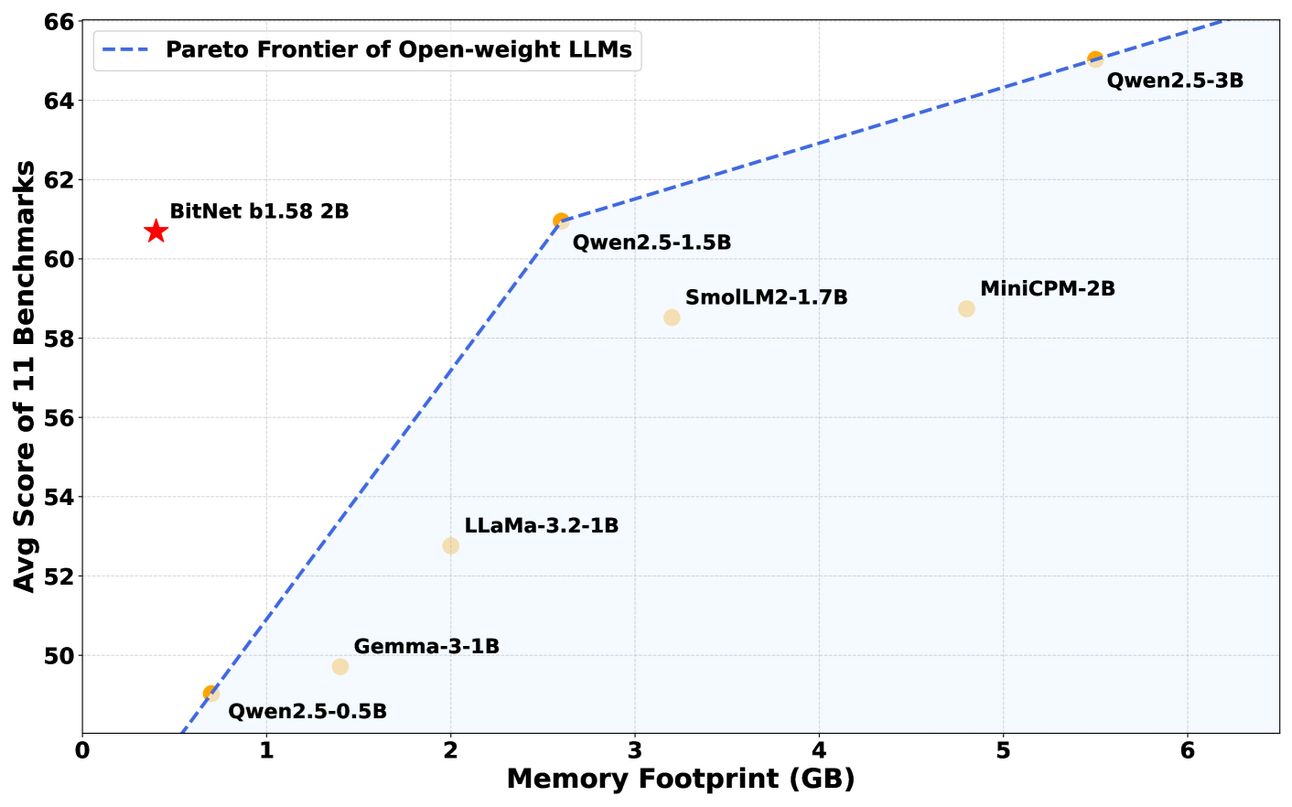

A maioria dos modelos de IA são como supermáquinas que consomem muita gasolina - potentes, mas que exigem muitíssima memória, energia e capacidade de processamento. O novo BitNet b1.58 2B4T, desenvolvido pela Microsoft Research, está mais para uma scooter elétrica: ágil, eficiente e perfeita para andar por espaços apertados.

Qual é a novidade? É o primeiro LLM de código aberto que utiliza quantização para reduzir o número de bits necessários para representar pesos, tornando-o mais leve e rápido. Em outras palavras, em vez de usar o intervalo típico de valores para pesos, o BitNet b1.58 2B4T utiliza apenas três valores: -1, 0 e 1. Pesos dizem ao modelo “quanto confiar” em cada informação recebida.

O resultado? O BitNet b1.58 2B4T é muito eficiente e pode ser executado em CPUs tradicionais. O modelo se equipara em desempenho aos principais LLMs de precisão total, peso aberto e tamanho similar, como LLaMA 3.2 1B ou Qwen2.5 1.5B, utilizando apenas 0,4 GB de memória e reduzindo o consumo de energia em até 90%.

Crédito: Microsoft Research

A mágica por debaixo do capô:

Em vez de 16 ou 32 bits, o BitNet utiliza uma arquitetura de 1 bit que quantiza pesos em valores ternários. Isso reduz o tamanho do modelo e permite cálculos super-rápidos.

Treinado com 2 bilhões de parâmetros e 4 trilhões de tokens, o modelo passa por três fases: pré-treinamento (para aprender conhecimentos gerais), ajuste fino supervisionado (para seguir instruções) e otimização direta (para se alinhar às preferências humanas).

Para aqueles que se interessaram, o download está disponível aqui.

AI_GOVERNANCE & ETHICS

🍎 Apple em busca de melhores modelos de IA

A Apple está usando privacidade diferencial e dados sintéticos para aprimorar seus modelos de IA após enfrentar críticas devido ao desempenho abaixo do esperado. Funciona assim: 1) Dados sintéticos imitam o formato e as propriedades de dados reais dos usuários (por exemplo, e-mails). 2) Pequenos pacotes desses dados sintéticos são enviados a um subconjunto de dispositivos de usuários (que precisam aceitar compartilhar informações dos dispositivos com a Apple). 3) Então, esses dispositivos comparam os dados sintéticos com uma amostra dos dados reais (processados localmente) para avaliar a precisão dos modelos de IA da Apple. 4) Por fim, os resultados são agregados e anonimizados antes de serem enviados de volta à Apple para identificar lacunas de desempenho.

🪟 Falta de transparência

O lançamento do Gemini 2.5 Pro pelo Google sem um relatório de segurança correspondente gerou críticas por violar compromissos assumidos com o governo dos Estados Unidos e em cúpulas internacionais sobre transparência em IA. Essa omissão levanta preocupações sobre a priorização da implantação rápida em detrimento do desenvolvimento responsável. Especialistas temem que empresas de tecnologia voltem atrás em suas promessas de segurança devido a pressões competitivas e mudanças no cenário político.

AI_SNAPSHOT

💡 Inovação & Inspiração

Junto e combinado A Apple e a Universidade Sorbonne estão pesquisando em conjunto como a fusão precoce e as arquiteturas esparsas podem promover a IA multimodal. Os pesquisadores estão comparando modelos de fusão precoce, que processam entradas multimodais brutas diretamente, com abordagens tradicionais de fusão tardia para determinar se a última apresenta alguma vantagem inerente. A fusão precoce combina dados brutos de diferentes modalidades no nível da entrada, exigindo alinhamento e pré-processamento. A fusão tardia conecta codificadores de dados de visão pré-treinados com modelos de linguagem. 🍎🗼

Junto e combinado de outra forma Pesquisadores do MIT e do MIT-IBM Watson AI Lab criaram uma abordagem para complementar LLMs com outros modelos baseados em grafos, que se concentram em relações entre diferentes entidades. Qual é o objetivo? Perguntar a um chatbot, em linguagem simples, como criar uma molécula com certas propriedades e receber uma descrição detalhada de como sintetizá-la. E com isso ajudar a projetar novos medicamentos e materiais. 💬🖇

🌍 IA Global

🇬🇧 IA em solo real O projeto Stargate de US$ 500 bilhões financiado por SoftBank, OpenAI e Oracle, está considerando futuros investimentos no Reino Unido para construção de infraestrutura para IA.

🇳🇱 Competição internacional Um desafio entre startups de todo os países, promovido pelo Extreme Tech Challenge (XTC), está buscando soluções sustentáveis para atender às crescentes demandas de energia da IA. Serão avaliadas inovações nas áreas energética e futuramente infraestrutura e datacenters. As inscrições para a primeira fase do desafio estarão abertas até 30 de abril. Cinco finalistas apresentarão suas ideias no palco da Conferência TNW em 19 de junho em Amsterdã.

📰 How-to

A OpenAI apresentou discretamente o Memory with Search por meio do changelog e páginas de suporte. O recurso reescreve prompts automaticamente para fazer consultas mais personalizadas. Por exemplo, transforma "restaurantes perto de mim" em "bons restaurantes veganos em São Francisco", lembrando que você é vegano e mora em São Francisco.

No entanto, você pode controlar o que o ChatGPT memoriza, limpando memórias específicas, todas elas ou desativando a memória por completo. Veja como a seguir:

Crédito: OpenAI

PS1: Se quiser conversar sem usar ou atualizar a memória, use o Chat Temporário.

PS2: A OpenAI está liberado gradualmente o acesso aos recursos de memória para planos Plus e Pro. Plano gratuito têm acesso apenas a memórias salvas.

AI_TOOLKIT

🛠 Ferramentas

📚 Mais recursos

A entrevista de Sam Altman, CEO da OpenAI, no TED 2025 destacou sucessos e desafios enfrentados pela empresa com a transformação rápida da sociedade promovida pela tecnologia.

Um artigo da Harvard Business School examina como a IA Generativa impacta a colaboração em um experimento de campo com 776 profissionais da Procter & Gamble. Eles trabalharam em desafios de inovação de produtos, designados aleatoriamente para usar IA ou não e para trabalhar individualmente ou em equipe. Os resultados revelaram que a IA melhora significativamente o desempenho dos profissionais.

AI_FLASH_NEWS

O CloudMatrix 384 Supernode, novo sistema de IA da Huawei, promete superar o desempenho da infraestrutura da NVIDIA com 300 petaflops de poder computacional.

O Perplexity AI será integrado aos smartphones Samsung e Motorola, como alternativa ao Gemini AI do Google. O acordo está mais adiantado com a Motorola, e discussões estão em andamento com a Samsung.

A Chatbot Arena, plataforma de benchmarking de IA, será renomeada como LMArena e fará parte da nova empresa Arena Intelligence. A iniciativa visa garantir financiamento e um ambiente neutro para testes de IA.

A startup de biotecnologia Profluent aplicou técnicas de IA semelhantes às usadas em LLMs no desenvolvimento da família de modelos ProGen3 para design de proteínas.

A DocuSign lançou agentes guiados por IA para analisar contratos, sinalizar riscos e identificar problemas que normalmente exigem revisão humana.

A Anthropic investiu US$ 1 milhão na Goodfire, startup que decodifica o funcionamento interno dos modelos de IA.

Pesquisa da Febraban mostra que 80% dos bancos incorporam IA Generativa em operações e reportaram ganhos mensuráveis, com aumento médio de 11,4% na eficiência dos processos pós-adoção.

Filmes feitos com IA agora são elegíveis para ganhar o Oscar, de acordo com um anúncio da Academia de Artes e Ciências Cinematográficas. 🕴 🏆

Até a próxima

Obrigado por mergulhar nesta edição. Seu tempo é valioso, e estamos felizes por você ter escolhido passar alguns minutos aqui.

Voltaremos à sua caixa de entrada em breve. Até lá, cultive a curiosidade.😊